- হরিদাস পাল আলোচনা বিজ্ঞান ও প্রযুক্তি

-

এসো শিখি কল্প জগতে নকলের কারসাজি (Deep fake learning)

Rajkumar Raychaudhuri লেখকের গ্রাহক হোন

আলোচনা | বিজ্ঞান ও প্রযুক্তি | ১১ সেপ্টেম্বর ২০২০ | ৭৬৮৬ বার পঠিত নকলের প্রসঙ্গ উঠলেই নিজেকে জাহির করার একটা তীব্র বাসনা জেগে ওঠে মনের মধ্যে। যদিও স্কুল জীবনে বরাবর নকলের বিরুদ্ধে ছিলাম, তবে সংস্কৃত পরীক্ষার সময় আমার খাতা থেকে টুকতে দিয়ে বন্ধুদের পাশ করানোর আনন্দ এখনো মনে মনে টের পাই। তবে শুরুতেই স্বীকার করে নেওয়া অত্যুক্তি হবে না, মিনি,মাইক্রো জেরক্স ইত্যাদির পদ্ধতি সম্পর্কে কিছুটা অবহিত থাকলেও আমার সেই সকল পন্থা অবলম্বন করার সুযোগ ঘটেনি বা বলা ভাল, সাহসে কুলায় নি। যদিও এই সুক্ষ্ম আনন্দের রেশ সকলের মধ্যে ভাগ করা যায় না, তাতে সীমাহীন তিরষ্কারের আশঙ্কা থাকে, কিন্তু, মনে হয় এই আনন্দলাভের আশাতেই নকল মাহাত্ম্যের জয়জয়কার।

তবে বাস্তব জগতে নকলের গতি প্রকৃতি এক রকম, বস্তুত সেটা একপ্রকার আত্মকেন্দ্রিক। আর সেই নকল যখন কল্পজগতে গিয়ে ঠাঁই নেয় তখন তার রকমফের হয়ে দাঁড়ায় এক রকম। উদাহরণ হিসাবে বলা যেতে পারে সোশ্যাল মিডিয়ায় আপনার প্রোফাইলের ছবি নিয়ে আপনার নামেই কেউ আরেকটা প্রোফাইল খুলে বসে আপনার বন্ধুদের বন্ধুত্বের আহ্বান জানাল অথবা আলটপকা মন্তব্য করে আপনার সম্মান হানি করে বসল। অনেকেই নকল প্রোফাইলের বিড়ম্বনায় পড়ে বেশ বিব্রত হয়েছেন। ফলে ফেসবুক এই নকল রুখতে প্রোফাইল লকের সুবিধা এনে দিয়েছে সকলের জন্য।

এখন এই নকল ব্যাপারটা যদি আরেকটু উচ্চ স্তরের হয় তবে কি হবে? ধরা যাক, একটা ভিডিও বানানো হল আপনাকে নিয়ে যেখানে দেখা যাচ্ছে আপনি হয়তো কোন বিখ্যাত ব্যক্তির নামে বা অন্য কারোর নামে অসম্মান সূচক কথা বলে যাচ্ছেন, কিন্তু বাস্তবে আপনি হয়তো সেটা আদৌ করেন নি। কি অবাক হচ্ছেন? এটা বাস্তব জগতে অবাস্তব হলেও কল্পজগতে প্রযুক্তির গুণে কিন্তু খুব সম্ভব। এক্ষেত্রে অন্য কেউ অসম্মান সূচক কথাগুলো বলল আর সেটা আপনার ছবি ও আপনার গলার নকল করে আপনার নামে চালিয়ে দিল। কল্পনার পাখাটা আরেকটু বড় করে মেলে ধরি। এবার ব্যাপারটা আমার আপনার থেকে ছাড়িয়ে যদি কোন রাজনৈতিক ব্যক্তিত্বের ক্ষেত্রে ঘটে! যদি কোন রাজনৈতিক নেতার ছবি ও গলা নকল করে সোশ্যাল মিডিয়ায় কোন ভাইরাল ভিডিওর মাধ্যমে মিথ্যা প্রচার শুরু হয়! আসল সত্য আসার আগেই মানুষের মনোজগতে একটা আলোড়ন ফেলতে বাধ্য।

এখন প্রশ্ন উঠতে পারে এই ধরণের নকলের কারসাজি ঘটছে কি করে? নকলের কারসাজিতে যে কল্প প্রযুক্তি ব্যবহৃত হয় তার পোশাকি নাম ডিপ ফেক লার্নিং (Deep fake learning)। মূলত কৃত্রিম বুদ্ধিমত্তার ( Artifical Intelligence) সাহায্যে কিছু কারচুপি চালিয়ে এই ধরণের নকল ভিডিও করা হয় যাতে দর্শকদের কাছে নকল জিনিস আসল মনে হয়। ডিপ লার্নিং পদ্ধতি মূলত যে পদ্ধতির উপর ভিত্তি করে গঠিত তার নাম গ্যান (GAN-Generative Adversarial Network)।

নাম যেমনই হোক, সোশ্যাল মিডিয়া ঘাঁটতে যারা অভ্যস্ত তাদের অনেকেরই ‘গ্যান’-র গরিমা সম্পর্কে কিন্তু অজান্তে ধারণা আছে। কিছুদিন আগে দেখা যেত প্রত্যেকে নিজের ভবিষ্যতে বৃদ্ধ বয়সে কেমন দেখতে হবেন এ নিয়ে মজার ছবি প্রোফাইলে দিতেন। সেটা সম্ভব কিন্তু ‘গ্যান’-র গুণেই। বয়সের সাথে সাথে প্রত্যেক মানুষের অবয়ব কেমন পরিবর্তন হবে তা জানা যায় এই গ্যান-র সাহায্যেই। স্বভাবতই প্রশ্ন আসবে ‘গ্যান’ কি করে এই কাণ্ড গুলো ঘটায়। এই ‘গ্যান’ মাহাত্ম্য বর্ণনার আগে আসুন একটু কল্পনায় কিছু আঁকিবুকি কাটি।

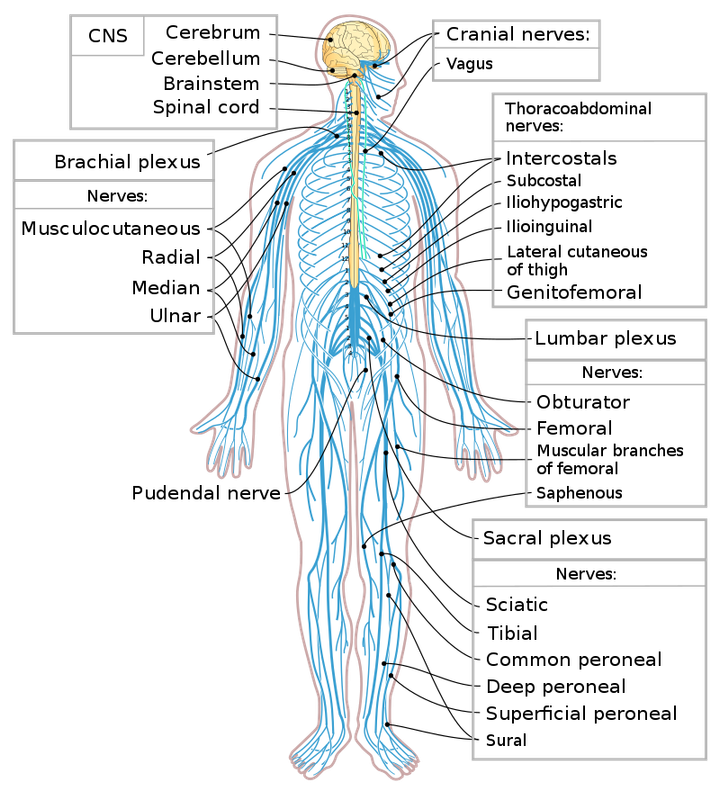

কল্পনা ১- ধরা যাক, আপনি আমার এই লেখাটা বেশ মনোযোগ সহকারে পড়ছেন। ঠিক এমন সময়ে একটা মশা বিনা বাক্যব্যয়ে কুটুস করে পায়ে হুল ফোটাল। আপনি হয় উঃ! করলেন বা করলেন না, কিন্তু না দেখেই সময় খরচ না করেই চটাস করে নির্দিষ্ট স্থানে চাঁটি মেরে মশাকে মেরে মনে মনে শান্তি পেলেন। এই যে নিমেষের মধ্যে সমস্ত ঘটনাটা ঘটল, এর ভেতরে ভেতরে অনেক ঘটনাই ঘটে গেছে যা হয়তো আপনার অজানা। না দেখেই আপনি যে কাণ্ডটা ঘটালেন, বিজ্ঞানের ভাষায় একে বলে প্রতিবর্ত ক্রিয়া (Reflex action)। আমাদের সারা শরীর জুড়ে অসংখ্য নিউরোনের বাস, যা পারষ্পরিক যুক্ত হয়ে আমাদের মাথার সাথে যোগসূত্র গড়ে তোলে। আমাদের মস্তিষ্কের সেরিব্রাল কর্টেক্সেই প্রায় ১০০০- ২০০০ কোটি নিউরোন (ছোট করে ১০-২০ বিলিয়ন) লক্ষ্য করা গেছে। সেরিবেলামে আছে প্রায় ৫,৫০০ – ৭,৭০০ কোটি (বা, ৫৫- ৭৭ বিলিয়ন)।

সারা শরীর জুড়ে নিউরোন জালিকাকারে যোগসূত্র গড়ে তুলেছে, (সৌজন্যে- উইকিপিডিয়া)

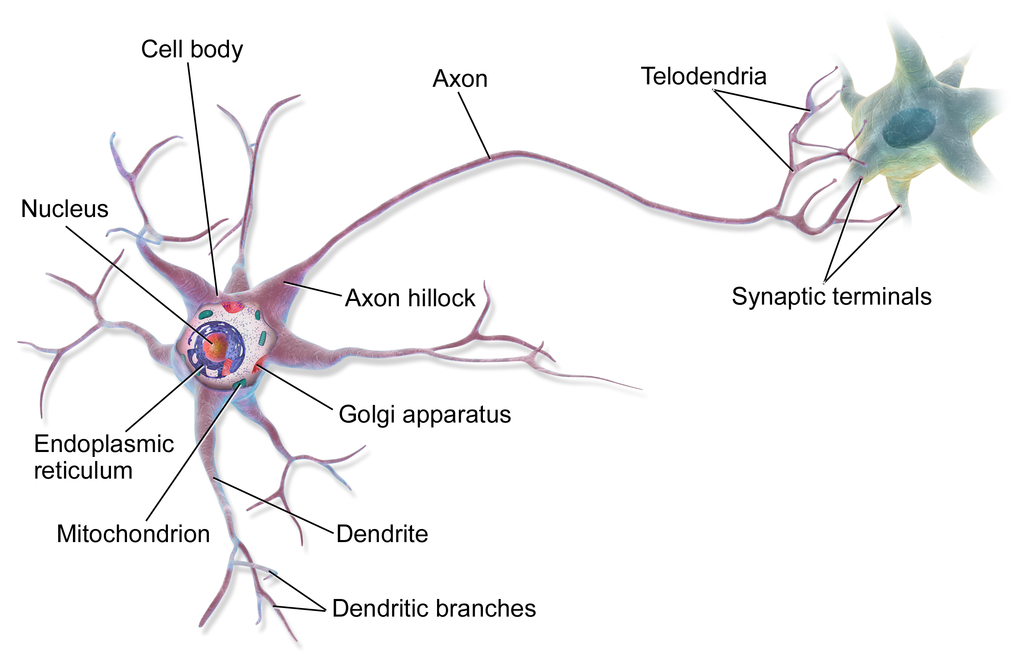

মশা যখন আপনার পায়ে হুল ফোটাল, তখন সেই বেদনা জনিত সঙ্কেত নিউরোন গ্রহন করে আপনার মাথায় পাঠাল, যদিও আপনার চোখ কিন্তু আমার লেখা পড়তে ব্যস্ত, আপনার মাথা নির্দেশ দিল হাতকে সঠিক স্থানে চাঁটি কষাতে। আপনিও লেখা থেকে চোখ না সরিয়ে চাঁটি মেরে তৃপ্তি লাভ করলেন। এখন এই যে নিউরোনগুলো পর পর সজ্জাক্রমে থাকে, একটি নিউরোনের শেষ ও অন্য নিউরোনের শুরুর সংযোগস্থলকে সাইন্যাপস(synapse) বলে।

দুটো নিউরোনের সংযোগস্থল- সাইন্যাপ্স(synapse), (সৌজন্যে- উইকিপিডিয়া)

যে সঙ্কেত আপনার পা থেকে মাথা পর্যন্ত গেল বা মাথা থেকে হাতে, তা কিন্তু অসংখ্য সাইন্যাপ্সের মাধ্যমে তরঙ্গ আকারে পরিবাহিত হয়ে পৌঁছাল। এইরকম কতশত সঙ্কেত যে নিউরোন জালকের মাধ্যমে আপনার মস্তিষ্কে যায়, আর আপনার মাথা ঠান্ডাভাবে প্রয়োজনীয় নির্দেশ দিয়ে সমস্যার সমাধান করে।

কল্পনা-২, ধরা যাক, আপনি খুব ভাল আঁকার শিক্ষক। আপনি আপনার ছাত্রকে রবীন্দ্রনাথ আঁকতে দিয়েছেন। সে যার ছবি আপনাকে দিল, তা রবীন্দ্রনাথ না হলেও মোটামুটি একটা কিছু। আপনি তার মন রাখার জন্য সেই ছবিকে বাতিল না করে কিছু পরিবর্তন ঘটিয়ে রবি ঠাকুরের আকৃতি দিলেন। এই আকৃতি দেওয়ার সময় লক্ষ্য করে দেখা যাবে ছবিতে রবি ঠাকুরের সাদৃশ্য যতটুকু আছে তা মিলিয়ে নিয়ে অপ্রয়োজনীয় অংশ মুছে আপনি আসল ছবির সাথে মিলিয়ে কিছু জুড়ে রবি ঠাকুর আনলেন। তাতে দেখা গেল রবি ঠাকুর পুরোপুরি না এলেও রবি ঠাকুরের কাছাকাছি। দূর থেকে দেখলে রবি ঠাকুরই লাগে, কাছে গেলে বোঝা যায় কিছু অসঙ্গতি।

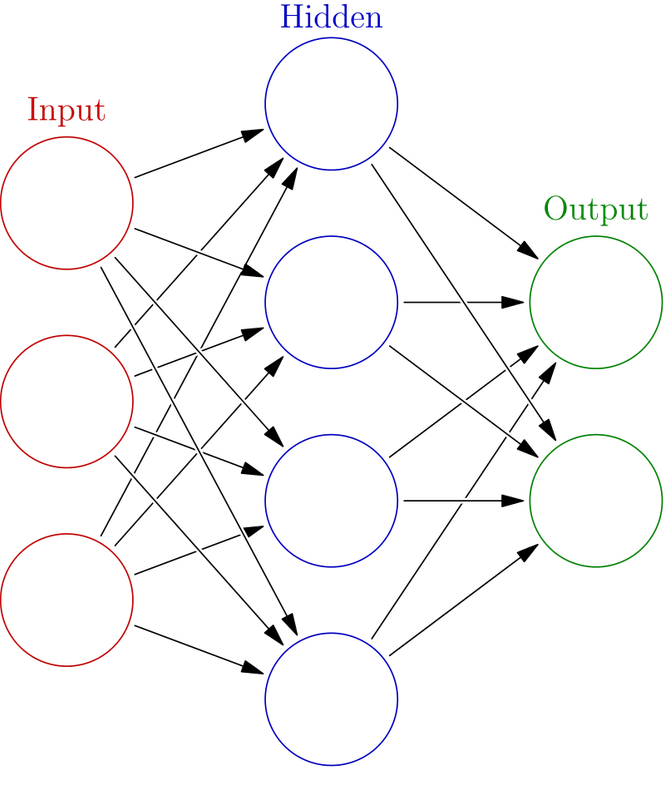

আপনি নিশ্চয়ই ভাবছেন খামোকা কল্পনার এত আঁকিবুকি কেন? আসলে গ্যান-এর গরিমা বর্ণনায় এই কল্পনার আঁকিবুকি আমাদের কাজে লাগবে। আমাদের কম্পিউটারে আমরা যা কিছু লিখি বা নির্দেশ দিই তাকে কম্পুটারের ভাষায় বলে ইনপুট(input), আর এই লেখার পরিবর্তে ডিসপ্লে ইউনিটে আমাদের চোখের সামনে যা কিছু ভেসে ওঠে তা হল আউটপুট(output)। আমরা কল্পনা ১ এ নিউরোন জালকের যে কথা বলে ছিলাম ঠিক তেমনি ভাবে গ্যান কৃত্রিম নিউরাল জালিকা(Artificial Neural Network) –র উপর ভিত্তি করে গঠিত।

কৃত্রিম নিউরাল জালিকা (Artificial Neural Network), (সৌজন্যে- উইকিপিডিয়া)

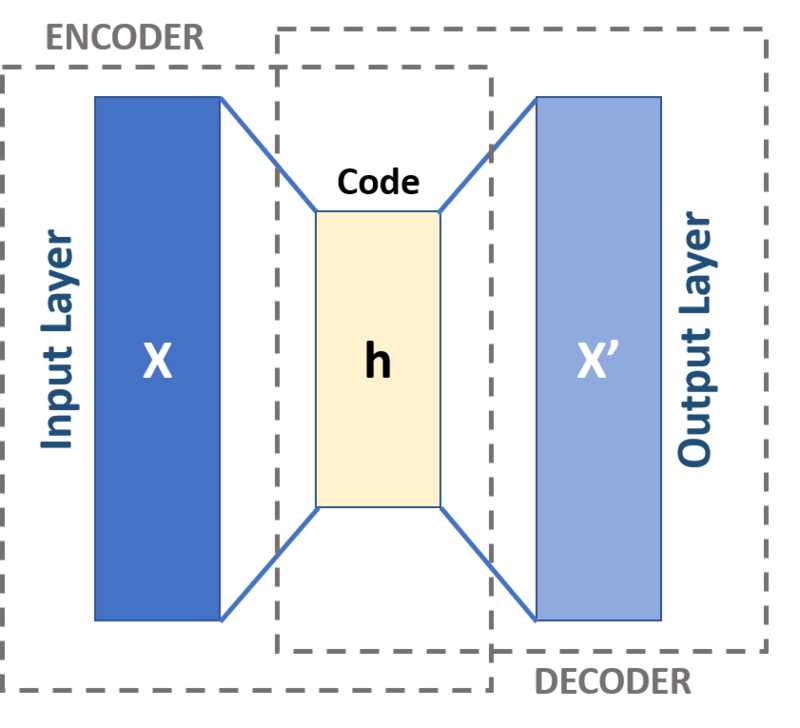

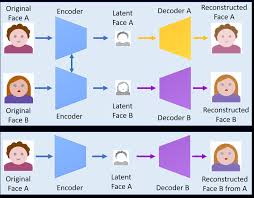

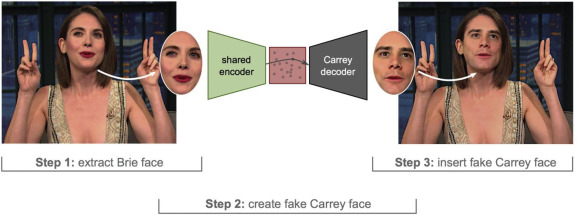

এই নিউরাল জালিকাকে সাহায্য করে স্বয়ংক্রিয় এনকোডার(Auto encoder)। স্বয়ংক্রিয় এনকোডারের একদিকে থাকে এনকোডার(encoder) আর অন্যদিকে থাকে ডিকোডার(decoder)।মাঝে থাকে কল্পনা ২ এ বর্ণিত মাস্টার মশাইয়ের মত অদৃশ্য একজন, যার পোশাকি নাম ল্যাটেন্ট স্পেস (Latent space)। এনকোডার, ল্যাটেণ্ট স্পেস, ডিকোডার সকলেই নিউরাল জালিকা দ্বারা সংযুক্ত। জেনেরেটর থেকে কোন নির্দিষ্ট ছবি বা গলার স্বর ইত্যাদি যা সঙ্কেত বা ইনপুট আসে এবং তা ল্যাটেন্ট স্পেস –এ জমা হয় এবং তা থেকে বিচার বিশ্লেষন করে ডিকোডার আবার সেটা পরিমার্জন করে আসল ইনপুটের কাছাকাছি মিলিয়ে আউটপুট হিসাবে তুলে ধরে। এই হল গ্যানের মোটামুটি কাজ।

স্বয়ংক্রিয় এনকোডার (Auto encoder), (সৌজন্যে- উইকিপিডিয়া)

এখন বোঝার সুবিধার্তে ধরলাম ক ছবিকে খ এর সাথে মেলাতে হবে। সেক্ষেত্রে, ক এবং খ এর উভয়ের-ই একজোড়া এনকোডার ডিকোডার লাগবে যারা ছবিগুলো নিয়ন্ত্রন করতে পারে এবং পরবর্তী সময়ে ক ও খ এর এনকোডারদ্বয় পরষ্পর তথ্য আদানপ্রদান করতে পারে। অন্যভাবে বলতে গেলে, ক ও খ এর ডিকোডারদ্বয়ের সাধারণ একটা এনকোডার থাকবে। এর ফলে, দুটি ডিকোডার ছবির মধ্যে যে গুলো নিয়ে কোন বিতর্ক হয় না এরকম মিল খুঁজতে সাধারণ এনকোডারের সুবিধা হবে। সাধারণত প্রত্যেকের মুখের মধ্যে নাক চোখ, ঠোঁটের অবস্থান একই থাকে। নিচের ছবিতে ক (Face A) থেকে খ (Face B)এর ছবির পরিবর্তন দেখানো হল।

(ডিপফেক পদ্ধতি- Deep fake method, সৌজন্য- Deep learning for Deep fake creation and Detection- A survey)

(ছবি ক থেকে ছবি খ তে পরিবর্তন, সৌজন্য – ইন্টারনেট)

দূরদর্শী কবি রবীন্দ্রনাথ ঠাকুর তাঁর ‘হিং টিং ছট’ কবিতায় লিখেছেন-

“ বিশ্বে কভু বিশ্ব ভেবে হবে না ঠকিতে,

সত্যেরে সে মিথ্যা বলি বুঝিবে চকিতে।

যা আছে তা নাই আর নাই যাহা আছে,

এ কথা জাজ্বল্যমান হবে তার কাছে।...”

ডিপ ফেক লার্নিং মানুষের কল্প জগতে সেভাবে থাবা বসাতে না পারলেও সুনিশ্চিত ভাবে ব্যবস্থা না নিলে ভবিষ্যত প্রজন্মের কাছে এর প্রভাব কিন্তু সাংঘাতিক। উদাহরণ স্বরূপ,‘ডিপট্রেস’ ল্যাব রিপোর্টে দেখা গেছে সমর্থন বহির্ভূত পর্ণগ্রাফি ভিডিও-র ৯৬% ডিপফেকের অধীন। এই ভিডিও গুলিতে অন্য প্রসিদ্ধ নায়ক/ নায়িকার মুখের অবয়ব জুড়ে দিয়ে ভাইরাল করা হয়।

সোশ্যাল মিডিয়ায় কোন গুজব দাবানলের মত ছড়ায়। সুতরাং কোন তথ্য ঠিক না বেঠিক তা যদি সুনিশ্চিত করা না যায়, সবাই সবার মত লেজুড় জুড়ে তিলকে তাল বানিয়ে সমাজের মধ্যে আলোড়ন ফেলে দেবে। সোশ্যাল মিডিয়া সাইটগুলি তাই ডিপফেকের অশনি সঙ্কেত নিয়ে যথেষ্ট চিন্তিত। এই ভিডিওগুলি আপনা-আপনি মুছে ফেলা শক্ত। তাই কৃত্রিম প্রযুক্তিকে কাজে লাগিয়ে কাঁটা দিয়ে কাঁটা তোলার কাজে ব্যবহার করতে চাইছে ফেসবুক।

ফেসবুক আয়োজিত ‘ডিপফেক ডিটেকশন চ্যলেঞ্জ’- এ সারা বিশ্বের ২১১৪ জন প্রতিযোগী ৩৫,০০০ ডিপফেক প্রশিক্ষিত তথ্যসম্বলিত মডেল জমা দিয়েছে। ফেসবুক কৃত্রিম প্রযুক্তিকে প্রশিক্ষিত করতে ৩৪২৬ জন অভিনেতাদের দিয়ে খুব বড় ধরণের তথ্যসম্বলিত মডেল (প্রায় ১ লাখ ভিডিও ক্লিপিং) ছেড়েছে। প্রতিযোগিতাটা আর কঠিন করার জন্য ট্রেনিং সেট ও টেস্ট সেট এ আর কিছু ভিডিও সংযোজিত করা হয়েছিল যাতে সনাক্তকরণ পদ্ধতিকে আরো বেশি বিবেচনা করতে হয়। যেমন কেউ মেকাপের ক্লাস করছে এবং ছবির রেসিউলেশন, অভিমুখ পালটে বক্তার মুখের উপর কোন লেখা ছেপে দেওয়া হল। প্রতিযোগিতার প্রথম পাঁচ প্রতিযোগীকে সনাক্তকরণ প্রক্রিয়া্র ক্ষেত্রে ফরেন্সিক পদ্ধতি গ্রহন করা ছাড়াও (অর্থাৎ ডিপফেক পদ্ধতিতে তৈরি হওয়া ভিডিওগুলোর ডিজিটাল পিক্সেলের ফিঙ্গারপ্রিন্টস সনাক্তকরণ পদ্ধতি গ্রহন ছাড়াও) আলাদা করে সাধারণ মানুষ যেভাবে কোন কিছু সন্দেহজনক দেখলে খুঁটিয়ে দেখে সেই পদ্ধতি অবলম্বন করতে হয়েছিল। এই পদ্ধতি গ্রহন করতে সকলে গতবছর কনভোলিউশন নিউরাল নেটওয়ার্ক (CNN- Convolution Neural Network) –এর উপর তৈরী গুগুল গবেষকদের নতুন সফটওয়ার এফিসিয়েণ্ট নেটস (Efficient Nets) এর সাহায্য নিয়েছিল। ছবি বিশ্লেষন করতে সিএনএন ব্যবহৃত হয় এবং মুখের অবয়ব বা কোন কিছু বস্তু সনাক্তকরণের ক্ষেত্রে তা উপযোগী। প্রতিযোগিতায় বিজয়ী প্রতিযোগী, ‘ম্যাপবক্স’ ফার্মের এ আই প্রযুক্তিবিদ সেলিম সেফারবেকভ যে মডেল বানিয়েছেন তা দিয়ে ডিপফেক রোধে বানানো ঐ ১ লাখ অজ্ঞাত ভিডিও-র উপর পরীক্ষা করে দেখা গেছে ৬৫% ডিপফেক ভিডিও সনাক্ত করা সম্ভব। এই নিখুঁত সনাক্তকরণ ক্ষমতা বাড়ানোর ক্ষেত্রে একটা নির্দিষ্ট সীমার পর আরো পরিমার্জন প্রয়োজন। এফিসিয়েন্ট নেটস শক্তপোক্ত সফটওয়ার এবং এই পরিশীলিত পরিষেবা দিতে সক্ষম হলেও ঠিক কি কারণের জন্য তাঁদের সনাক্তকরণ ক্ষমতার উন্নতি করা সম্ভব হয় নি তা স্পষ্ট করে বলতে পারেননি বিজয়ী প্রতিযোগী। যদিও ফেসবুক এই মডেল নিজের সাইটে ব্যবহার করতে আগ্রহী নয়। কারণ ৬৫% সনাক্ত করণ ক্ষমতাসম্পন্ন কোন মডেল কোন সোশ্যাল সাইটে ব্যবহার করার ক্ষেত্রে উপযোগী নয়। তবে কিছু কিছু মডেল প্রশিক্ষিত মডেলের ক্ষেত্রে ৮০% সনাক্তকরণে সক্ষম হলেও অজ্ঞাত ভিডিও সনাক্তকরণের ক্ষেত্রে তাদের গুণমান নিম্নগামী। সেলিম সেফারবেকভ মনে করেন নতুন ভিডিও পরীক্ষার ক্ষেত্রে অনেক নতুন নতুন পদ্ধতির ব্যবহার করা দরকার যেটা এই প্রতিযোগিতার ক্ষেত্রে কঠিনতম কাজ।

‘Witness’ প্রজেক্টের ডাইরেক্টর স্যাম গ্রেগরিক সোশ্যাল মিডিয়াকে ডিপফেক নির্ধারণের ক্ষেত্রে এইরূপ গঠনগত অর্থব্যয়কে স্বাগত জানিয়েছেন। তিনি বলেছেন ভবিষ্যতের ভয়াবহ অবস্থার সাথে লড়াইয়ের ক্ষেত্রে এইরূপ প্রস্তুতির আবশ্যকতা আছে। তিনি সেলিম সেফারবেকভের সাথে একমত যে এই ডিপফেক প্রযুক্তি খুবই জঘন্য এবং লিঙ্গবৈষম্য ও ভুল তথ্য সরবরাহের ক্ষেত্রে মারাত্মক আকার ধারণ করতে পারে।

তথ্য সূচী

https://en.wikipedia.org/wiki/Deepfake

https://en.wikipedia.org/wiki/Synthetic_media

https://en.wikipedia.org/wiki/Autoencoder

https://en.wikipedia.org/wiki/Generative_adversarial_network

https://en.wikipedia.org/wiki/Latent_variable

https://arxiv.org/pdf/1909.11573.pdf

পুনঃপ্রকাশ সম্পর্কিত নীতিঃ এই লেখাটি ছাপা, ডিজিটাল, দৃশ্য, শ্রাব্য, বা অন্য যেকোনো মাধ্যমে আংশিক বা সম্পূর্ণ ভাবে প্রতিলিপিকরণ বা অন্যত্র প্রকাশের জন্য গুরুচণ্ডা৯র অনুমতি বাধ্যতামূলক। লেখক চাইলে অন্যত্র প্রকাশ করতে পারেন, সেক্ষেত্রে গুরুচণ্ডা৯র উল্লেখ প্রত্যাশিত।- আরও পড়ুনএই যে - Srimallar Speaksআরও পড়ুনলক্ষ্মীর ভাণ্ডার থেকে অন্নপূর্ণা ভাণ্ডার: বঞ্চনার জন্যই কি নতুন প্রকল্প? - বাংলা গবেষণা কেন্দ্রআরও পড়ুনহিমাচলের ইতি উতি - ৭ - দআরও পড়ুনধুলোট //০৮ - albert banerjeeআরও পড়ুনধুলোট //০৭ - albert banerjeeআরও পড়ুনহ্যাঁ, রুজেভিচ। - যদুবাবুআরও পড়ুনবড় হওয়ার বিপদ - Amit Chatterjeeআরও পড়ুননতুন ফর্ম - সৈকত বন্দ্যোপাধ্যায়

- মতামত দিন

-

বিষয়বস্তু*:

স্বাতী রায় | 42.*.*.* | ১১ সেপ্টেম্বর ২০২০ ১৪:৩৫97149

স্বাতী রায় | 42.*.*.* | ১১ সেপ্টেম্বর ২০২০ ১৪:৩৫97149বা: ইন্টারেস্টিং বিষয় তো। কিছুই জানতাম না, শেখার আগ্রহ তৈরি করল।

Rajesh Bhattacharjee | 202.*.*.* | ১১ সেপ্টেম্বর ২০২০ ১৪:৪৯97150

Rajesh Bhattacharjee | 202.*.*.* | ১১ সেপ্টেম্বর ২০২০ ১৪:৪৯97150খুব ভালো লাগলো অনেক ধন্যবাদ আপনাকে

-

Rajkumar Raychaudhuri | ১১ সেপ্টেম্বর ২০২০ ১৬:৫২97154

@ স্বাতী রায় ধ্ন্যবাদ। বিজ্ঞান নিয়ে সাধারণের মধ্যে আগ্রহ জাগাতে পারলেই আনন্দ। @রাজেশ ভট্টাচার্য ধন্যবাদ

সত্যজিত মিত্র | 202.*.*.* | ১২ সেপ্টেম্বর ২০২০ ০৯:৪৪97164

সত্যজিত মিত্র | 202.*.*.* | ১২ সেপ্টেম্বর ২০২০ ০৯:৪৪97164আপনার এই লেখা সোশ্যাল মিডিয়া বিষয়ে মনে ভয়ের সঞ্চার হলো।

-

যদুবাবু | ১৪ সেপ্টেম্বর ২০২০ ০২:২৩97226

বাংলায় ডিপ লার্নিং নিয়ে লেখা খুব একটা নেই, থাকলেও সহজ করে বুঝিয়ে লেখার চেষ্টা কেউ করেছেন কিনা জানা নেই, সেই চেষ্টাটা করেছেন বলে রাজকুমার-বাবুকে ধন্যবাদ !

যেহেতু ডিপ-লার্নিং/ এ-আই নিয়ে লেখা, তাই কিছু জায়গায় এ-আই-এর অন্যান্য বায়াসের বিষয়ে একটু কিছু বাদ গেছে মনে হলো। অল্প করে লিখছি। প্রথম, ডিপ নিউর্যাল নেটওয়ার্কের অ্যাকিউরেসি প্রায় পুরোটাই ডিপেন্ড করে ট্রেনিং স্যাম্পলের কোয়ালিটির উপর, জঞ্জাল ঢোকালে জঞ্জাল-ই বেরোবে যাকে বলে ... কাজেই অনেক অনেক অ্যাপ্লিকেশনেই দেখা যায় ট্রেনিং স্যম্পলের বায়াস প্রেডিকশনের সময় কয়েকগুণ অ্যামপ্লিফায়েড হয়ে বেরিয়েছে - এই বায়াস কাদের বেশী অ্যাফেক্ট করে? যাদের রিপ্রেজেন্টেশন ডেটায় কম, অর্থাৎ সাধারণভাবে মার্জিনালাইজড গ্রূপের লোকেদের-ই। এই সমস্যাটা সমস্যা হয়ে দাঁড়ায় যখন ডিপ লার্নিং ব্যবহার করে লোকে অপরাধী শনাক্ত করতে চায় অথবা পলিসি ঠিক করার কথা ভাবে ...

এ ছাড়া আরও কিছু কিছু অস্বস্তির জায়গা আছে, যেমন একটা এই যে ডিপ নিউর্যাল নেটওয়ার্ক আদতে একটি ব্ল্যাক বক্স - ভেতরে কি হচ্ছে বোঝা দায়, কাজেই যদি ভুল-ও করে, যদি বায়াসড পলিসি-ও তৈরী করে বা ভুল লোককে জেলে পুরে দেয়, তাহলেও দায় কার সেটা পরিষ্কার নয়। প্রেডপোল নামে একটি সফটোয়্যার-কে নিয়ে এই কারণে গুচ্ছ হইচই হয়েছে, সে সব ঘটনা "মাইনরিটি রিপোর্টে"র মতন ভয়ের ... আর দুঃখের কথা এই যে, পুলিস/ল-এনফোর্স্মেন্টের লোকেরা বলেন, আমি বায়াসড নই, তোমাদের অ্যালগোরিদম বায়াসড ... আর অ্যালগোরিদম-কে তো আর কাঠগড়ায় দাঁড় করানো যায় না! আশার কথা যে এই নিয়ে স্ট্যাট-মেশিন লার্নিং কমিউনিটির লোকেরা সচেতন হচ্ছেন, আর কিছু হোক না হোক, কিছু লোক চ্যাঁচাচ্ছেন ফেয়ারনেস ইত্যাদি নিয়ে, হয়তো আস্তে আস্তে কিছু ভালো পরিবর্তন আসবে, না হোক কিছু রেগুলেশন হয়তো হবে, দেখা যাক !

-

Rajkumar Raychaudhuri | ১৫ সেপ্টেম্বর ২০২০ ০৯:৫১97241

সত্যজিৎ মিত্র বাবু, আগুন ভয়ঙ্কর আবার এই আগুন আমাদের উপকারেও লাগে। আমাদের সোশ্যাল মিডিয়ার উপকারিতা ও অপকারিতা সম্পর্র্কে সচেতন হতে হবে। সে কারণে এই ধরণের লেখা। আপনাদের লেখাটা সজাগ করে দিতে পারলেই লেখক হিসাবে আমার বড় প্রাপ্তি।

যদু বাবু, আপনার ধন্যবাদে আমি আপ্লুত হলাম। আমার ইচ্ছা প্রযুক্তি বিজ্ঞানের উপর বাইরে নানা কর্র্মকান্ড ঘটে চলেছে সেগুলো বাংলার মানুষের সামনে গল্প আকারে তুলে ধরা।

তাছাড়া বাংলাতে গল্প আকারে বিজ্ঞান আলোচনা খুব ই কম . ইচ্ছা আছে ধারাবাহিক ভাবে কিছু লেখা .

- মতামত দিন

-

বিষয়বস্তু*:

-

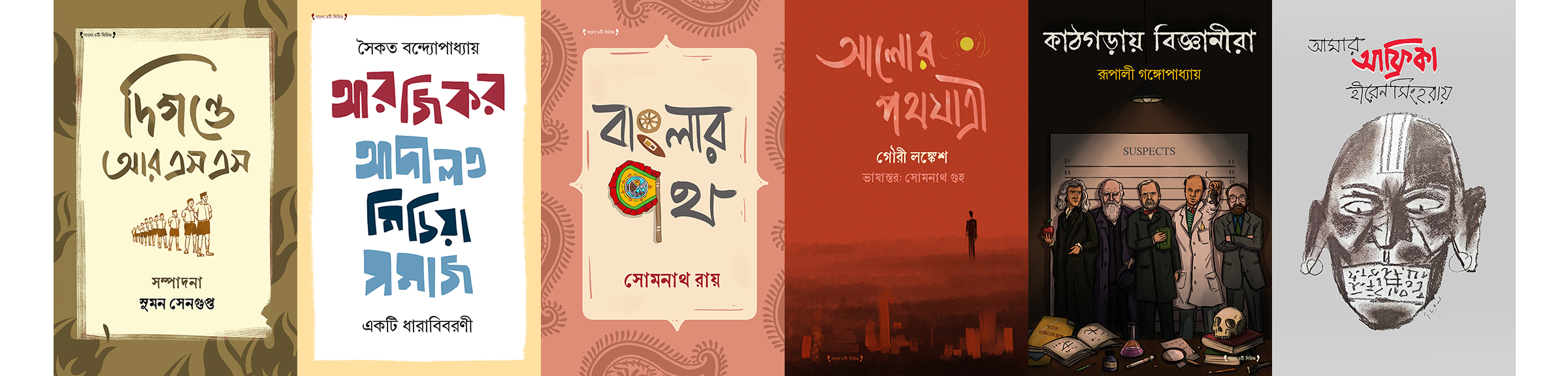

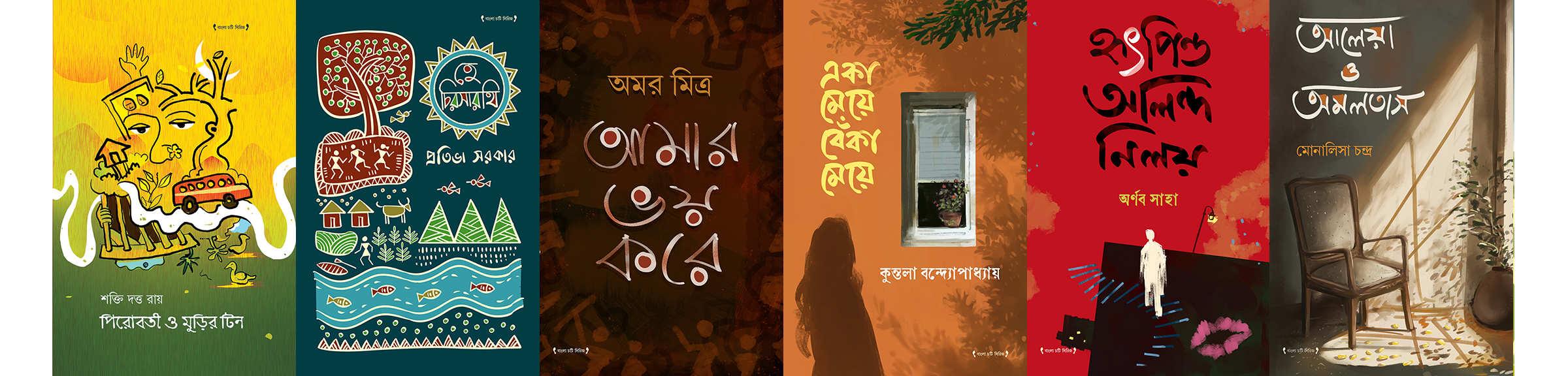

গুরুচণ্ডা৯-র বই দত্তক নিন

কোনোরকম কর্পোরেট ফান্ডিং ছাড়া সম্পূর্ণরূপে জনতার শ্রম ও অর্থে পরিচালিত এই নন-প্রফিট এবং স্বাধীন উদ্যোগটিকে বাঁচিয়ে রাখতে এককালীন বা ধারাবাহিক ভাবে গুরুভার বহন করুন।

- ভাটিয়ালি | টইপত্তর | বুলবুলভাজা | হরিদাস পাল | খেরোর খাতা | বই

-

- টইপত্তর, ভাটিয়া৯, হরিদাস পাল(ব্লগ) এবং খেরোর খাতার লেখার বক্তব্য লেখকের নিজস্ব, গুরুচণ্ডা৯র কোন দায়িত্ব নেই। | ♦ : পঠিত সংখ্যাটি ১৩ই জানুয়ারি ২০২০ থেকে, লেখাটি যদি তার আগে লেখা হয়ে থাকে তাহলে এই সংখ্যাটি সঠিক পরিমাপ নয়। এই বিভ্রান্তির জন্য আমরা দুঃখিত।

গুরুচণ্ডা৯-র সম্পাদিত বিভাগের যে কোনো লেখা অথবা লেখার অংশবিশেষ অন্যত্র প্রকাশ করার আগে গুরুচণ্ডা৯-র লিখিত অনুমতি নেওয়া আবশ্যক। অসম্পাদিত বিভাগের লেখা প্রকাশের সময় গুরুতে প্রকাশের উল্লেখ আমরা পারস্পরিক সৌজন্যের প্রকাশ হিসেবে অনুরোধ করি। যোগাযোগ করুন, লেখা পাঠান এই ঠিকানায় : [email protected] ।

মে ১৩, ২০১৪ থেকে সাইটটি বার পঠিতপড়েই ক্ষান্ত দেবেন না। না ঘাবড়ে মতামত দিন।